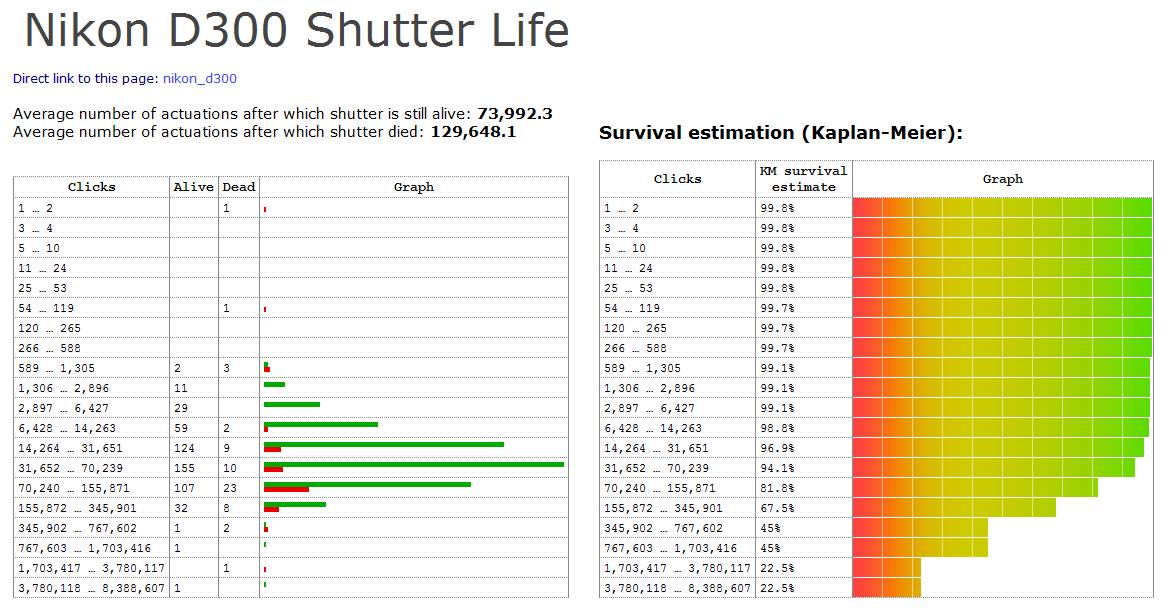

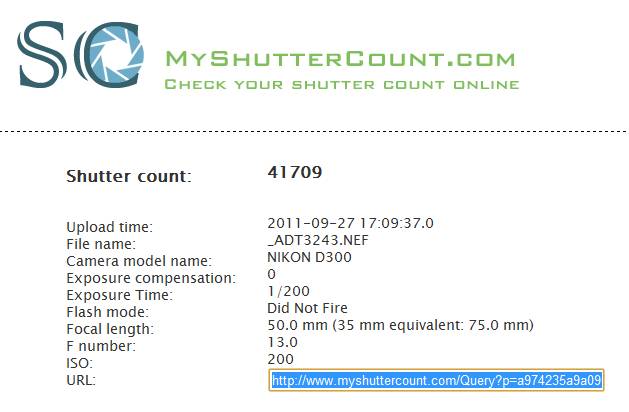

Ieri abbiamo parlato, anzi abbiamo ricordato dell’esistenza di MyShutterCount.com, il servizio on line che, con il semplice upload di una foto, vi dice il numero di scatti fatti dalla vostra fotocamera, ma se volessimo sapere quanti ancora ne mancano prima che la vostra fotocamera sia kaput? I produttori danno dei numerelli a riguardo, numerelli che […]

Quanti scatti farà la mia reflex?